Meta tendrá en cuenta más los audios y las fotografías manipulados con herramientas de IA, además de los vídeos, como parte de los cambios que ha introducido en sus políticas, que empezará a identificará como tal en mayo.

Meta ha actualizado su política sobre manipulación multimedia siguiendo las recomendaciones del Consejo asesor, que consideraba que «se enfocaba inapropiadamente en cómo se ha creado el contenido, en lugar de qué daños específicos pretende prevenir».

Los cambios amplían el tipo de contenido sobre el que actúa la política, ya que hasta ahora se ha limitado a «los vídeos creados o alterados por IA para que parezca que una persona dice algo que no dijo».

De esta forma, Meta busca reflejar la evolución que se ha experimentado en los contenidos manipulados desde la redacción de la política en 2020, «cuando el contenido realista generado por IA era poco común y la preocupación general eran los vídeos», como explica en su blog oficial.

En estos años los contenidos realistas generados por IA se han extendido también a audio y fotografías, a lo que se añade que se trata de una tecnología está en constante evolución. Asimismo, el cambio en la política pretende también abordar la manipulación que muestra a una persona haciendo algo que no hizo.

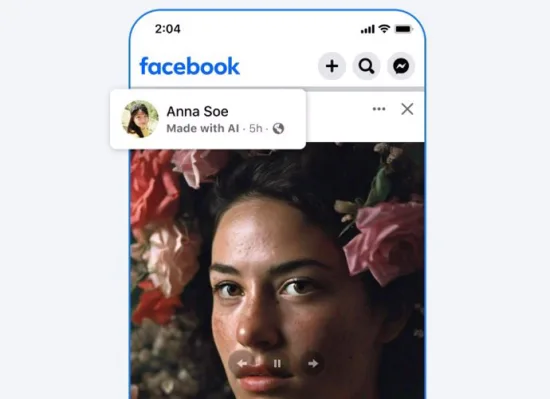

«Las etiquetas cubrirán una gama más amplia de contenido además del contenido manipulado que el Consejo asesor recomendó etiquetar» y, adicionalmente, si determinan que «las imágenes, los vídeos o los audios creados o alterados digitalmente» crean un riesgo alto de engaño sobre un asunto público de importancia podrán «agregar una etiqueta más destacada para que las personas tengan más información y contexto».

Estos cambios se aplicarán en Facebook, Instagram y Threads. En mayo comenzarán a etiquetar el contenido generado con una herramienta de IA y un mes más tarde dejarán de eliminar contenido » únicamente sobre la base de nuestra política de videos manipulados».